易翻译对东北话的识别有一定能力,但不会完美无误。识别准确度受方言浓重程度、发音差异、儿化音和变调、背景噪声以及软件训练样本覆盖的影响。普通话夹杂较多、语速适中且发音清楚时,结果会更好。若想提高成功率,可选用短句、放慢语速、在安静环境录音,或尝试在设置中选择更宽容或方言识别模式。日常使用通常够用。哦!

先把问题拆开:什么是“识别东北话”

先说一个比喻:把语音识别比作“听懂口音的耳朵”。普通话就是那只常见的、训练有素的耳朵;东北话则是带着浓重地方腔调、说话有儿化、有独特词汇的“口音”。当你问“易翻译能识别东北话吗”,其实是在问两件事:软件的“耳朵”能不能听懂那些声学特征(发音、调值、儿化等),还能不能把听到的句子映射到正确的词或意义上。

核心机制简单说明(费曼法:把复杂说清楚)

语音识别通常有两个主要部分:声学模型和语言模型。声学模型负责把声音波形变成音素或音节的可能序列;语言模型负责根据上下文把这些音素组合成最可能的词句。东北话在声学上常见特点包括

- 儿化音频繁(如“啥儿”比“啥”更常见);

- 局部变调和连读,一句话里音节连接得比普通话紧密;

- 特殊词汇和口语表达(“嘎哈”“甭客气”等);

- 语速和韵律往往更随性,重音位置可能不同。

如果声学模型和语言模型的训练数据里,包含大量类似东北口音的样本,识别就会好;否则就可能被误判为相近的普通话词汇或直接出错。

易翻译实际表现:能做到什么程度?

我想把回答拆成几类场景,方便你在实际使用时有个预期。

1) 淡东北口音(普通话夹杂方言)

这种情况下识别率通常较高。原因是发音大体接近普通话,声学模型仍能匹配到对应的音素序列,语言模型也能基于上下文纠错。也就是说,平时工作或旅行中,带一点地方腔但句子结构接近普通话,易翻译大概率能正确翻译。

2) 明显东北腔(儿化、地方词多)

准确率会明显下降。儿化可能导致模型听成其他音节,地方词可能根本不在模型的词表里,导致替换或漏译。举例:把“吃串儿”识别成“吃串”或“吃 春儿”(错误断词)都可能发生。

3) 非标准、强方言变体或口音很重的对话

误识别概率高,特别是在背景噪音或同时多人说话时。此时结果可能是片段正确、片段错误,需要人工校对。

一个小表(对比预期准确率,供参考)

| 场景 | 典型准确率(语音→文本) | 影响因素 |

| 普通话夹杂少量东北腔 | 85%–95% | 清晰度、语速、短语化 |

| 明显东北腔、常用地方词 | 60%–80% | 儿化、词汇覆盖、训练数据 |

| 浓重方言、俚语多、噪音 | 30%–60% | 背景噪声、多人对话、模型泛化能力 |

为什么会有这些差异?从技术角度说几句

不用太多数学,简单说三件事决定识别好不好:

- 训练数据覆盖度:模型在训练时有没有见过类似的东北口音?没有就难以泛化。

- 声学特征差异:儿化、鼻化、连读等会改变短时频谱,声学模型需要足够鲁棒。

- 语言模型和词表:如果词表不包含“嘎哈”“甭管”等词,模型就会用最接近的普通话词去替代。

常见错误类型(举例说明)

- 断词错误:本该是“吃串儿”,被识为“吃串”;

- 替换错误:地方词“嘎哈”被识为“干啥”或“嘎哈”变成拼音近似词;

- 删词/插词:连读音被当作停顿或噪声,导致词被丢失或插入无关词汇。

用户层面:如何把识别正确率做到最好(实用技巧)

把这当成“我出门要做的几步”,很生活化:

- 尽量说清楚、放慢语速:尤其是关键词和地名;

- 短句优先:一句话不要太长,分成短句能减少连读带来的错误;

- 减少背景噪音:关窗、靠近麦克风或使用耳机麦克风;

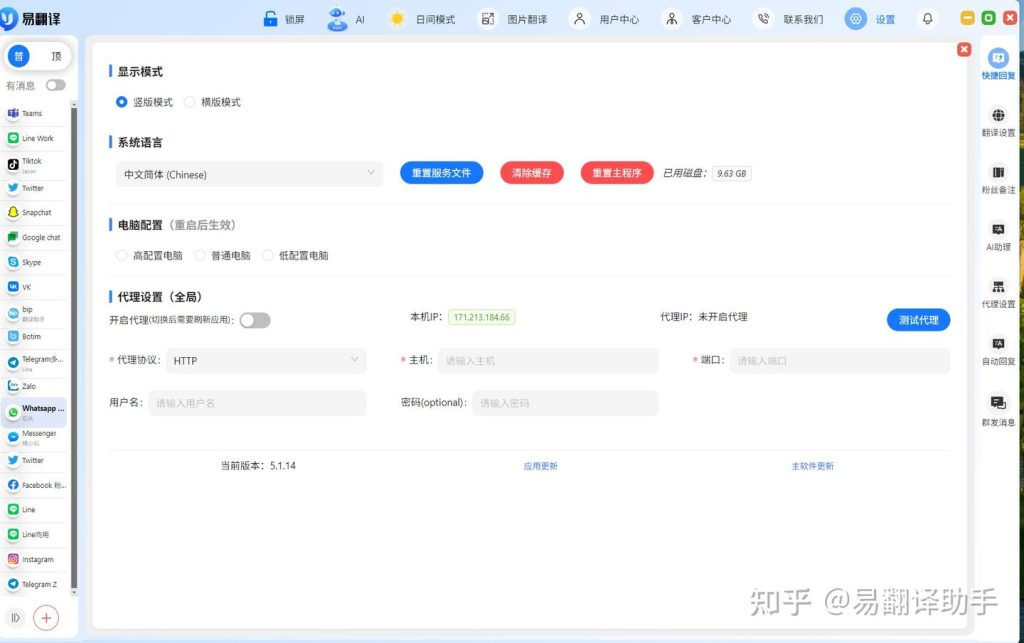

- 尝试切换语言或方言设置:如果软件支持方言识别选项,启用它;

- 后置校对:把识别结果快速扫一遍再翻译,必要时手动修正关键词;

- 用示例短句训练个人词库:如果应用支持自定义词典,把常用方言词加入。

开发者角度:怎么改进方言识别(简明步骤)

如果你是研发或产品经理,这里有更具体的思路:

- 数据采集:优先收集真实东北方言的语音样本(男女老少、不同场景);

- 声学模型微调:在已有模型(如Kaldi、Wav2Vec或类似架构)上进行方言微调;

- 语言模型扩展:把常见方言词汇、口语表达加入词表和N-gram/神经LM;

- 后处理策略:用规则或小模型修正儿化和连读引起的错误断词;

- 混合检测:先做方言检测(判断是否为东北话),再选择专门模型进行识别;

- 用户反馈闭环:内置纠错和上报机制,把用户修正回传作为新的训练数据。

常见问题解答(QA 风格,短而实用)

Q:是否有专门的“东北话”模式?

A:多数通用翻译软件先是以普通话为主,但一些产品会提供“方言识别”或通过模型更新逐步增强对地区口音的支持。具体到易翻译,是否有专门一键“东北话模式”要看版本和设置中有没有方言选项。

Q:离线模式能识别东北话吗?

A:离线模型通常受限于体积和覆盖词表,除非开发者专门把方言样本打包进离线模型,否则在线版本(借助云端更大的模型和更多数据)通常表现更好。

Q:能不能把方言直接翻译成另一种语言(如英文)?

A:这是两步的过程:先识别成中文文本,再从中文翻译成目标语言。如果第一步识别出错,第二步翻译自然受影响。所以方言能否被“正确翻译”取决于第一步识别质量。

一些实测小案例(说明前后差异,便于理解)

举两个生活化例子:

- 句子:你嘎哈呢?(东北口语)→ 若识别为“你干啥呢?”,翻译效果基本等同,意思保留;

- 句子:吃串儿去不?→ 若被识为“吃串 去 不”,机器可能在翻译时断句不自然,或者把“串儿”错误地拼成别的词。

对比其他工具的常见做法(简表说明)

| 策略 | 优点 | 缺点 |

| 通用普通话模型 | 稳定,覆盖面广 | 方言表现有限 |

| 方言专项模型 | 识别率高、专门优化 | 需大量数据,维护成本高 |

| 方言检测+切换模型 | 灵活,效果兼顾 | 检测错误会影响后续选择 |

隐私与使用建议(别忘了这些)

当你用语音翻译,数据可能会上传到云端用于识别或改进模型。注意查看应用隐私政策,尤其是是否同意把语音样本用于模型训练。如果担心隐私,可以选择离线模式(若可用)或手动文本输入。

最后,告诉你几句实用结语(像朋友唠叨)

好了,以上就是我边想着写给你看的那种说明。总的来说,易翻译对东北话能“听懂一半以上场景、很多日常场景足够用”,但遇到浓方言、俚语或噪音环境时要有心理准备:可能需要你简单修正一下结果。做个小实验——找个短句,在安静环境里分别用普通话和浓重东北腔说一遍,对比识别结果,你会更直观地感受到差异。要不要试试看?