易翻译对泰语五个声调的识别并非百分百准确,但在安静、标准发音与清晰录音下表现不错;在嘈杂环境、方言或快速语速时误判概率明显上升。实际效果取决于录音质量、说话人、模型训练和上下文处理等多种因素。如果你经常需要准确判断声调,建议结合文字输入、慢速语音与拍照取词等功能,并在重要场合请人工核对。

先把问题拆开:什么是“识别准”

要回答“准不准”,得先定义“准”。对一个应用来说,通常有两个层次:

- 声学识别层面:把语音信号里的基频(F0)、时长和能量等特征,判定为五个声调中的哪一个。

- 语义/翻译层面:即便声调被误判,最终的文字或翻译是否仍然传达正确意思。

这两层常常混在一起被用户感知:你听到的翻译对或不对,既受声调识别影响,也受语言模型和上下文补偿影响。

泰语五个声调长什么样(从听觉和声学上理解)

- 平调(mid):基频相对平稳,音高在中等位置。

- 低调(low):起始音高较低,整体偏低。

- 降调(falling):由较高音开始然后下滑。

- 高调(high):起始较高并保持在高位或略上扬。

- 升调(rising):从较低处上升到更高位置。

从工程角度来看,声学模型主要依赖基频曲线(F0 contour)、时长和能量等来区分这些模式,但实际说话中这些信号会被噪音、口音、连读和情感所“污染”。

影响识别准确性的关键因素

一句话:不是只有算法决定结果,环境和使用方式同样重要。

| 因素 | 对声调识别的影响 |

| 录音质量(麦克风、距离) | 高:清晰;低:基频检测误差增大 |

| 背景噪声/混响 | 噪声会掩盖高频或低频成分,下降准确率 |

| 说话人(方言、声带特性) | 方言和个体差异会改变基频范围与声学模式 |

| 语速与连读 | 快语速使声调边界模糊,连读造成基频过渡 |

| 模型训练数据规模与标注质量 | 决定模型能否学到不同说话人的多样性 |

| 是否使用语言模型/上下文 | 上下文好时,即便声调错,翻译仍可能正确 |

应用端常见实现手段(让你知道它是怎么“猜”声调的)

把复杂的实现拆成简单几步:

- 先做基频跟踪(pitch tracking),得到每帧的F0。

- 把F0、时长、能量等作为特征输入到声学模型(传统是GMM-HMM,现在常用深度神经网络、CTC或Transformer)。

- 结合语言模型(统计或神经网络)做解码,给出最可能的词或音节序列。

- 最后把文字或翻译输出,并可能做后处理纠错。

现代端到端系统会把声学特征和上下文一起学习,能在一定程度上用语义补偿声调判别错误,但它并不能总是“猜对”声调对应的词义。

评估一个工具识别声调是否“准”的实际做法

给你一套用户可操作的检验流程:

- 准备对照集:选取若干常见词、最小对立对(同一音节不同声调意义不同)和短句,保证有多名说话人(男女、不同口音)。

- 在不同环境录音:安静室内、室外、车内等。

- 用应用录入语音并导出识别结果,记录每条的声调判断或文字输出。

- 计算错误率:可用“声调错误率(Tone Error Rate, TER)”和词错误率(WER),并画混淆矩阵看哪些声调最容易混淆。

举个直观的例子(概念性说明)

想象把同一个音节 /ma/ 让五位说话人分别以五个声调读出并上传。理想情况下,正确分类会接近完美。但在嘈杂环境或说话人带外语口音时,识别器可能把“高调”误判为“平调”,或者把“降调”识成“低调”。从混淆矩阵你能直接看到哪些模式易混。

现实中你会遇到的问题与应对策略

- 问题:嘈杂环境识别差

应对:尽量靠近麦克风、使用降噪耳机或切换到文字/拍照输入。 - 问题:方言或非母语人士发音不标准

应对:使用慢速朗读、分词句或手动校对识别结果。 - 问题:短音节、单字难以判定

应对:把词放入一句话里,增加上下文帮助语言模型判断。 - 问题:即时翻译未显示声调信息

应对:在重要场合请人工校对或把语音先转为文字再由熟悉泰语的人核对。

一些经验法则(帮你在日常使用里降低误判)

- 录音时保持手机靠近嘴巴、语速慢一点。

- 尽量在安静环境或用带降噪功能的耳麦。

- 把不确定的词做文字输入或拍照查词(泰文字有声调标记,拍照识别通常更稳)。

- 遇到关键交流(合同、价格、姓名等)优先选择人工翻译或双重验证。

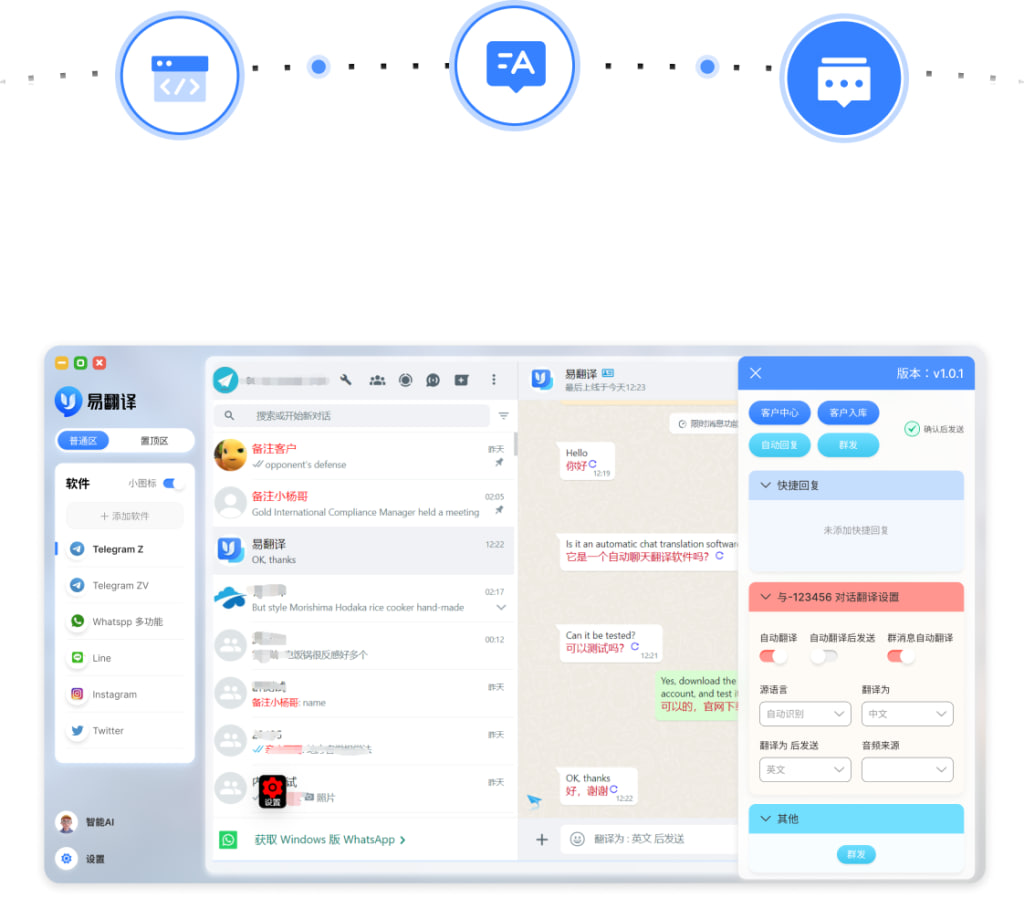

最后:对“易翻译”这类产品的总体期待值

现在的商业翻译工具在标准、清晰录音下,能把泰语的整体意思传达出来,大多数常见场景下足够用。但若你的需求是逐音、逐字、严格区分五个声调以决定词义(比如语言学研究、法律文件或某些精确命名),那么单靠自动识别不够稳妥。把自动化工具当成高效的第一步,再用文字输入、拍照校对或人工核验做第二步,会比较靠谱。

就先写到这儿了,顺带提醒一句:技术在进步,厂商也会不断更新模型,你可以不时做个小对照测试看看效果的改进情况。